I en nylig samtale med vår instruktør Rolf D. Henriksen pekte han på en situasjon mange virksomheter opplever nå: AI tas i bruk i høyt tempo – både gjennom planlagte initiativer og mer uformell bruk – ofte før organisasjonen har etablert tilstrekkelig kontroll over data, tilgangsstyring og ansvar.

Resultatet kan være at forventede gevinster raskt ledsages av nye risikofaktorer, blant annet knyttet til personvernregelverk, tillit, kostnadsnivå og tap av kritisk kompetanse.

“Let’s get AI everywhere” – men hvilke underliggende forhold påvirker risikoen?

Rolf beskriver en typisk lederreaksjon: høye forventninger til effektivisering og en ambisjon om å ta AI i bruk på bred front i organisasjonen.

Utfordringen er at AI ofte forsterker eksisterende strukturelle forhold i virksomheten – særlig knyttet til teknisk gjeld, fragmenterte datakilder, uklart dataeierskap og for brede tilgangsrettigheter.

Et konkret eksempel er Copilot. Verktøyet opererer i praksis innenfor de samme tilgangsrettighetene som brukeren. Dersom ansatte har bredere tilgang enn nødvendig – noe som ofte skjer når roller endres uten at rettigheter justeres – kan Copilot hente frem, koble sammen og synliggjøre informasjon på en måte som øker risikoen betydelig, særlig knyttet til personvern og sensitiv informasjon.

AI-risiko handler ofte om grunnleggende styring av data og tilgang

Rolf peker på at mange virksomheter fortsatt mangler tilstrekkelig oversikt over:

Et av de mest effektive risikoreduserende tiltakene er derfor også et av de mest grunnleggende: å etablere bedre kontroll over datagrunnlag og tilgangsstyring før AI-bruken skaleres.

GDPR, formålsbegrensning – og hvorfor gode intensjoner ikke er tilstrekkelig

Rolf trekker frem et eksempel fra offentlig sektor der intensjonen var å bruke AI/ML til å analysere risiko for fremtidig sykefravær, med mål om å kunne følge opp ansatte tidligere.

Initiativet ble stoppet av Datatilsynet, fordi GDPR stiller tydelige krav til formålsbegrensning: data kan ikke brukes til nye formål uten et gyldig rettslig grunnlag eller samtykke.

Dette er et viktig poeng også for privat sektor. AI-initiativer kan raskt føre til et ønske om å analysere og trene modeller på eksisterende datamengder. Dersom databruken ikke er avklart juridisk og etisk, kan initiativet innebære betydelig etterlevelses- og omdømmerisiko.

Den skjulte kostnaden: lisens, drift – og kompetansetap

Et annet sentralt poeng fra Rolf er at AI ikke kun handler om lisenskostnader eller tilgjengelige gratisverktøy.

Når virksomheter går fra eksperimentering til operativ bruk, oppstår kostnader knyttet til blant annet lisensiering, infrastruktur, modellforvaltning, dataplattform og kontinuerlig overvåking.

Han peker også på en kostnad som ofte undervurderes i beslutningsgrunnlaget: kompetansetap. Når AI overtar oppgaver som tidligere krevde faglig vurdering, kan organisasjonen gradvis miste evnen til å vurdere kvalitet, risiko og riktighet. Dette kan øke sårbarheten dersom systemer feiler, manipuleres eller blir utilgjengelige.

Derfor bør AI brukes i definerte prosesser – ikke som en generell løsning

Rolf understreker at god governance starter med tydelig avgrensning av bruksområder: hva er akseptabel bruk, og hva er det ikke.

Han trekker særlig frem høyrisikoområder, som rekruttering og kandidatvurdering, der AI kan påvirke rettigheter, likebehandling og beslutningsgrunnlag. Selv når verktøy inneholder innebygde begrensninger, kan funksjonaliteten i praksis omgås gjennom alternative formuleringer eller bruksmønstre.

Konklusjonen er derfor tydelig: AI må styres gjennom klare roller, tydelig definerte anvendelsesområder og eksplisitte styringsrammer.

Hva bør virksomheter prioritere nå?

Noen grunnleggende tiltak kan gi betydelig risikoreduksjon:

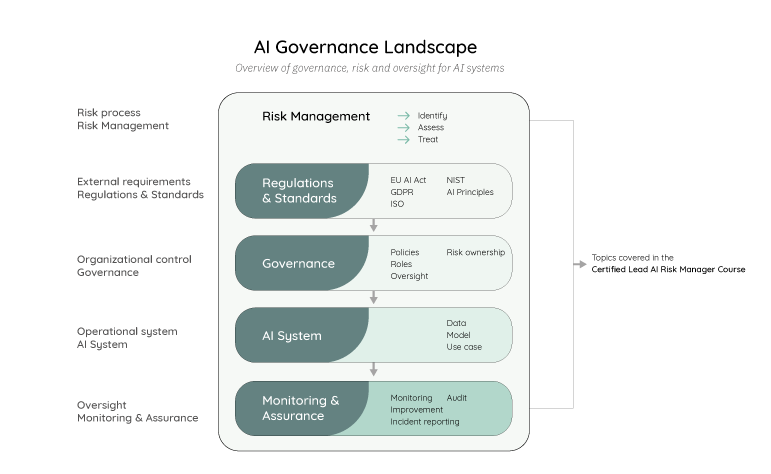

Kurset Rolf viser til: Certified Lead AI Risk Manager

Rolf beskriver kurset som et spesialistkurs for personer som skal arbeide med risikovurdering, styring og etterlevelse knyttet til AI.

Målgruppen er typisk et dedikert team eller en styringsgruppe med ansvar for vurderinger, kontroll og governance – ikke nødvendigvis alle ansatte.

Kurset gir en strukturert metode for å arbeide med AI-risiko på tvers av flere perspektiver, blant annet teknologi, data, personvern, etikk og virksomhetsstyring. Målet er å gi deltakerne et helhetlig rammeverk for å navigere i et stadig mer komplekst landskap av krav og hensyn.

For virksomheter som ønsker bedre kontroll før AI blir en kritisk del av driften, kan dette være et godt sted å starte.

Les mer om kurset her: Certified Lead AI Risk Manager